블로그로 돌아가기AI Models

GLM-5 Coding Benchmark - 코딩 성능 벤치마크

GLM-5 Coding Benchmark - 코딩 성능 벤치마크

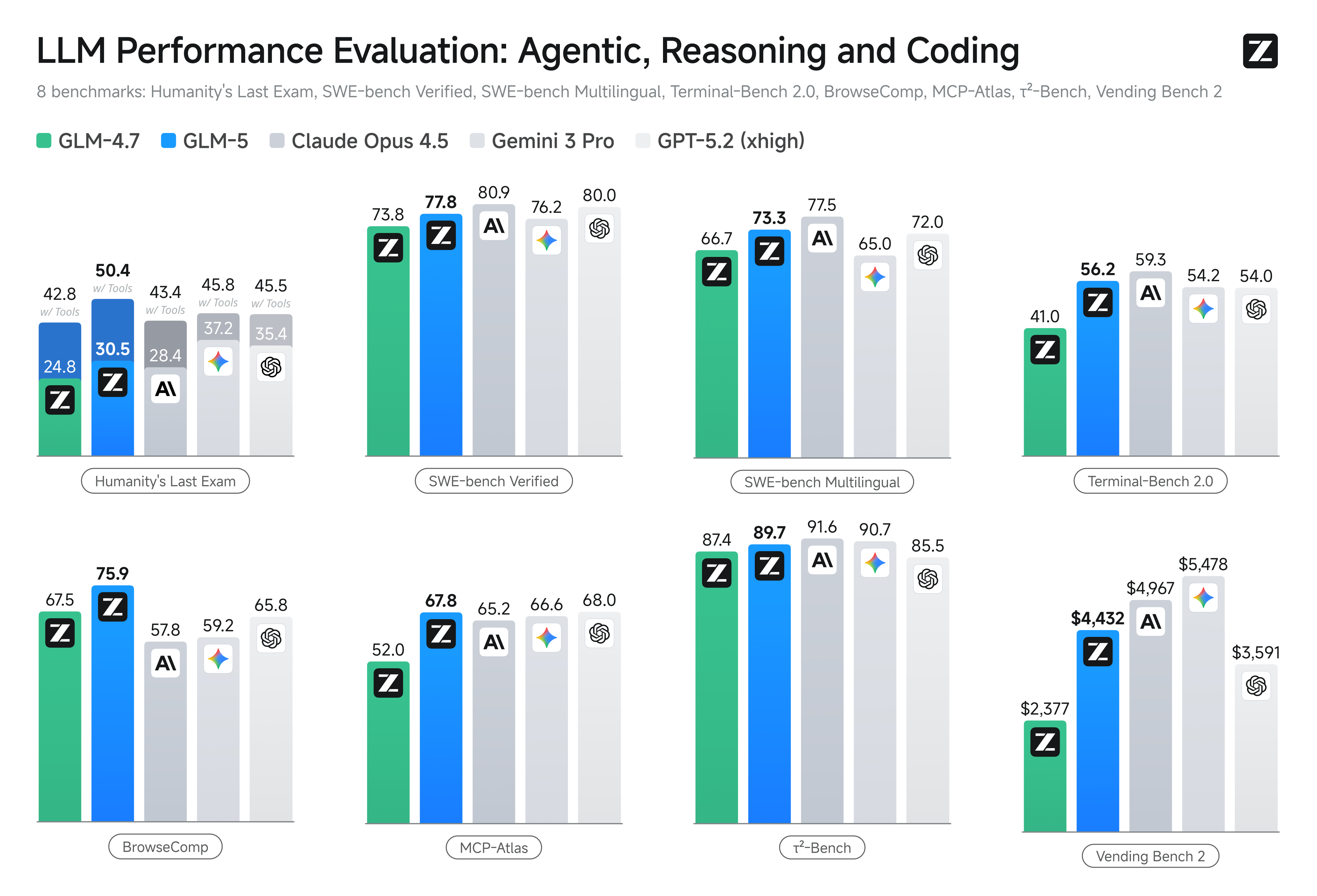

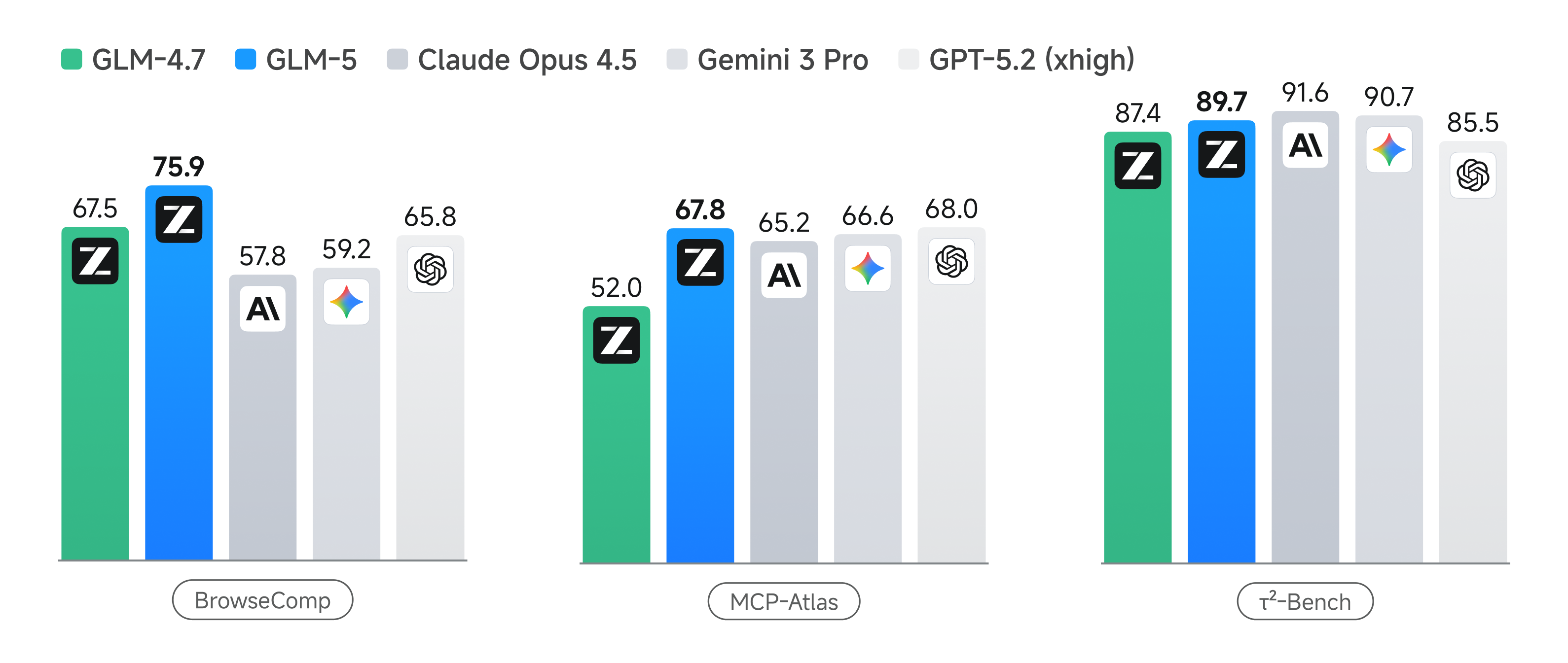

GLM-5 Agent Benchmark - 에이전트 성능 벤치마크

GLM-5 Agent Benchmark - 에이전트 성능 벤치마크

GLM-5 출시 리뷰: 745B MoE 아키텍처와 Claude Code 호환성

9.74분

GLM-5Zhipu AIMoAI-ADKClaude CodeMoE ArchitectureLLM

Zhipu AI의 첫 연례 플래그십 모델 GLM-5가 출시되었다. 745B MoE 아키텍처, 202K 토큰 컨텍스트, DeepSeek sparse attention 메커니즘을 분석하고 moai-adk 2.2.7 통합 방법을 설명한다.

개요

2026년 2월, Zhipu AI에서 첫 연례 플래그십 모델인 GLM-5가 출시되었다. 이번 출시는 단순한 모델 업데이트를 넘어, LLM 아키텍처의 중요한 진전을 보여준다.

본 문서에서는 GLM-5의 기술적 특징과 성능을 분석하고, MoAI-ADK를 통해 Claude Code에서 GLM-5를 활용하는 방법을 설명한다.

1. GLM-5 기술 아키텍처

1.1 핵심 기술 사양

GLM-5의 가장 주목할 만한 특징은 745B 파라미터 MoE (Mixture of Experts) 아키텍처다. 전통적인 밀집(dense) 모델과 달리, MoE는 활성화되는 전문가(expert) 그룹을 동적으로 선택하여 추론 효율성을 극대화한다.

Loading diagram...

MoE Architecture - 혼합 전문가 아키텍처 동작 원리

이 아키텍처의 핵심 장점은 다음과 같다.

- 효율적 추론: 전체 파라미터 중 일부만 활성화하여 추론 비용 절감

- 전문화된 학습: 특정 도메인에 특화된 전문가 그룹 병렬 학습

- 확장성 향상: 모델 크기 증가 시 선형적 성능 개선

1.2 컨텍스트 윈도우 확장

GLM-5는 202K 토큰 컨텍스트 윈도우를 지원한다. 이는 약 15만 단어에 해당하며, 다음과 같은 작업을 단일 세션에서 처리 가능하다.

- 대규모 코드베이스 전체 분석

- 수백 페이지 기술 문서 일관성 유지

- 복잡한 멀티파일 리팩토링

1.3 Sparse Attention 메커니즘

DeepSeek에서 영감을 받은 sparse attention 메커니즘이 적용되었다. 이는 토큰 간 관계 계산을 최적화하여 긴 컨텍스트 처리 시 연산 효율성을 개선한다.

Loading diagram...

Sparse Attention Flow - 희소 주의 메커니즘 처리 흐름

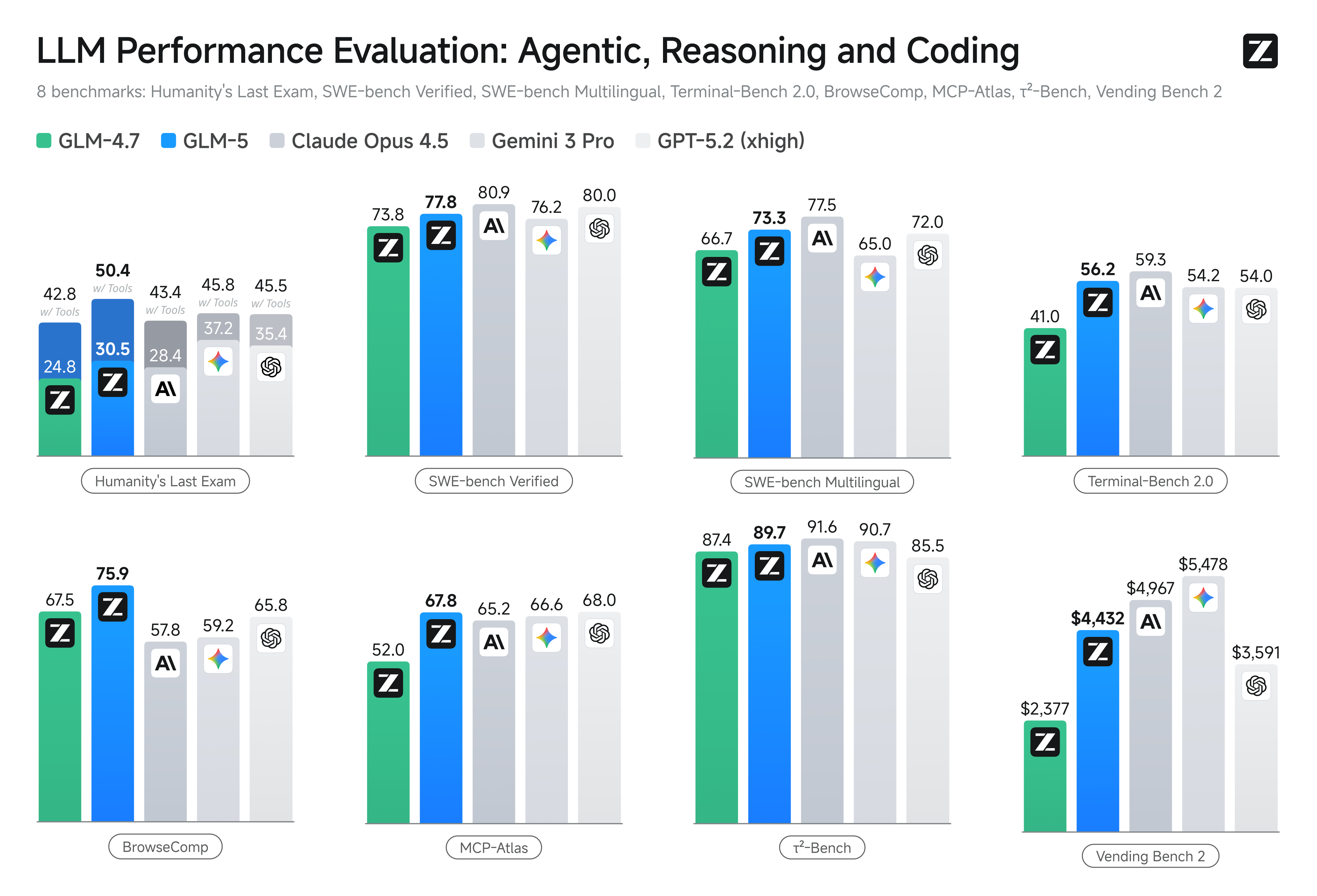

2. 성능 벤치마크 분석

2.1 코딩 성능

GLM-5는 오픈 소스 SOTA(State-of-the-Art) 코딩 성능을 보인다. 특히 실제 프로그래밍 작업에서 Claude Opus 4.5에 근접하는 성능을 입증했다.

GLM-5 Coding Benchmark - 코딩 성능 벤치마크

GLM-5 Coding Benchmark - 코딩 성능 벤치마크벤치마크 결과는 다음과 같은 특징을 보인다.

- 에이전트 작업 최적화: 복잡한 멀티스텝 코드 생성에서 높은 정확도

- 실무 시나리오 강화: 실제 개발 프로젝트에서의 성능 최적화

- 언어 균형: 다양한 프로그래밍 언어에서 일관된 성능

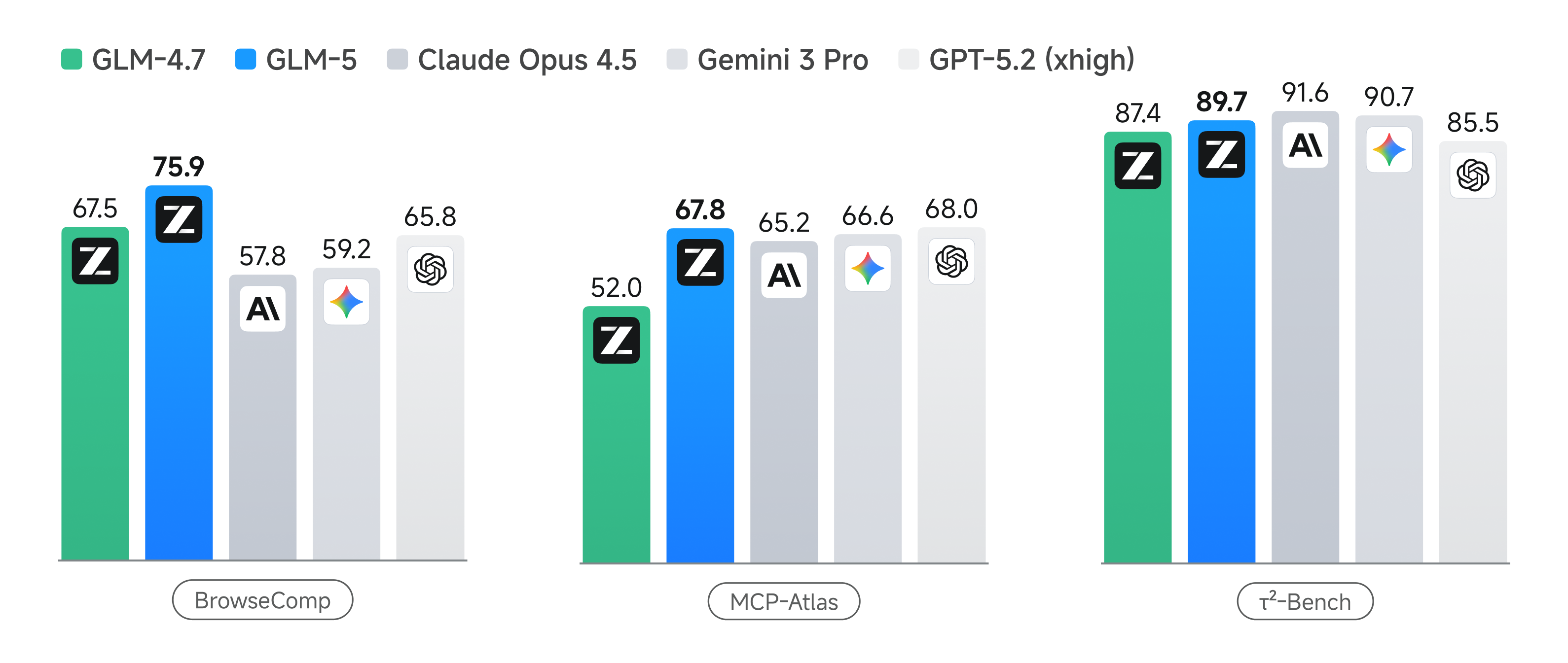

2.2 에이전트 성능

에이전트 기반 작업에서 GLM-5는 특히 강점을 보인다. 도구 사용, 계획 수립, 맥락 유지 능력이 종합적으로 평가된다.

GLM-5 Agent Benchmark - 에이전트 성능 벤치마크

GLM-5 Agent Benchmark - 에이전트 성능 벤치마크3. Claude Code 호환성

3.1 원클릭 통합

GLM-5는 Claude Code와 완벽 호환된다. Z.AI에서 제공하는 DevPack을 통해 별도의 코드 수정 없이 Claude Code에서 GLM-5를 사용할 수 있다.

이 호환성의 핵심은 OpenAI API 호환 레이어다. GLM-5는 표준 OpenAI API 엔드포인트 형식을 지원하여 Claude Code와의 통합을 단순화한다.

3.2 SDK 및 API 지원

GLM-5는 다양한 개발자 도구를 지원한다.

공식 Python SDK (zai-sdk)

Python

from zai import ZAIclient = ZAI(api_key="your-api-key")response = client.chat.completions.create(model="glm-5",messages=[{"role": "user", "content": "Explain MoE architecture"}],thinking=True # Enable reasoning mode)

OpenAI Python SDK 호환

Python

from openai import OpenAIclient = OpenAI(base_url="https://api.z.ai/api/paas/v4",api_key="your-zai-api-key")response = client.chat.completions.create(model="glm-5",messages=[...])

Java SDK

Java

ZAIClient client = new ZAIClient("your-api-key");ChatRequest request = ChatRequest.builder().model("glm-5").messages(messages).thinking(true).build();ChatResponse response = client.chat(request);

3.3 Thinking 파라미터

GLM-5는

thinking 파라미터를 지원한다. 이 파라미터를 활성화하면 모델의 추론 과정이 노출되어 디버깅과 검증 작업에 유용하다.| 파라미터 | 타입 | 설명 |

|---|---|---|

thinking | boolean | 추론 과정 노출 여부 |

max_tokens | integer | 최대 출력 토큰 수 |

temperature | float | 출력 무작위성 조절 |

4. MoAI-ADK 통합

4.1 moai glm 명령어

MoAI-ADK 2.2.7부터 GLM-5 사용이 지원된다.

moai glm 명령어로 Claude Code의 LLM 백엔드를 GLM-5로 전환할 수 있다.Bash

# 최초 설정 (API 키 저장)moai glm sk-xxx-your-api-key# 저장된 키로 전환moai glm# Claude로 복귀moai cc

이 명령어는 다음 작업을 자동으로 수행한다.

- API 키를

~/.moai/.env.glm에 안전 저장 (0o600 권한) .claude/settings.local.json에 환경 변수 주입.gitignore에 API 키 파일 자동 추가

4.2 MoAI-ADK 설치

MoAI-ADK는 Go로 작성된 단일 바이너리로 배포된다. 설치는 간단하다.

Bash

# macOS / Linux / WSLcurl -fsSL https://raw.githubusercontent.com/modu-ai/moai-adk/main/install.sh | bash# Windows PowerShellirm https://github.com/modu-ai/moai-adk/raw/main/install.ps1 | iex

설치 후 프로젝트를 초기화한다.

Bash

moai init my-projectcd my-project

4.3 GLM-5 활성화

프로젝트에서 GLM-5를 활성화하는 절차는 다음과 같다.

Loading diagram...

GLM-5 Setup Process - GLM-5 설정 프로세스

명령어 실행 예시:

Bash

# API 키와 함께 전환moai glm sk-xxx-your-zai-api-key# 출력 결과# GLM API key saved to ~/.moai/.env.glm# Switched to GLM backend.# Environment variables injected into .claude/settings.local.json# Run 'moai cc' to switch back to Claude.

생성된 설정 파일 구조는 다음과 같다.

JSON

{"env": {"ANTHROPIC_AUTH_TOKEN": "${GLM_API_KEY}","ANTHROPIC_BASE_URL": "https://api.z.ai/api/anthropic","API_TIMEOUT_MS": "3000000"}}

5. 가격 정책

5.1 GLM Coding Plan

Z.AI는 개발자를 위한 GLM Coding Plan을 3단계 요금제로 제공한다. Claude Code Max의 월 $80와 비교할 때 상당한 비용 절감 효과를 제공한다.

| 서비스 | 월 요금 | 연간 요금 | 주요 특징 |

|---|---|---|---|

| GLM Coding Lite | $10 | $120 | 입문용, 5시간당 ~80 프롬프트 |

| GLM Coding Pro | $30 | $360 | 활발한 개발자용, 5시간당 ~400 프롬프트 |

| GLM Coding Max | $80 | $960 | 헤비 유저용, 5시간당 ~1,600 프롬프트, GLM-5 지원 |

| Claude Code Max | $80 | $960 | Anthropic 공식, 1M 토큰 컨텍스트 |

5.2 비용 효율성 분석

GLM Coding Plan을 활용한 비용 절감 효과는 다음과 같다.

- 87.5% 비용 절감: Lite 기준 Claude Code Max 대비 연간 약 $840 절감

- 62.5% 비용 절감: Pro 기준 Claude Code Max 대비 연간 약 $600 절감

- 동일 가격, 더 많은 사용량: Max 기준 동일 $80에서 5시간당 ~1,600 프롬프트 제공

- 동등한 성능: 실제 프로그래밍 작업에서 Opus 4.5에 근접한 성능

결론

GLM-5는 Zhipu AI의 첫 연례 플래그십 모델로서, 기술적으로 중요한 진전을 보여준다. 745B MoE 아키텍처와 202K 토큰 컨텍스트 윈도우는 대규모 개발 작업에서 강력한 도구가 된다.

핵심 요약:

- 아키텍처 혁신: 745B MoE로 추론 효율성과 성능의 균형 달성

- Claude Code 호환: MoAI-ADK를 통한 원클릭 통합으로 복잡한 설정 불필요

- 비용 효율성: Lite $10부터 시작, Claude Code Max 대비 최대 87.5% 절감

- 실무 성능: 코딩 및 에이전트 작업에서 SOTA 수준 성능 입증

권장 다음 단계:

- Z.AI 구독 페이지에서 API 키 발급

- MoAI-ADK 설치:

curl -fsSL https://raw.githubusercontent.com/modu-ai/moai-adk/main/install.sh | bash - GLM-5 전환:

moai glm sk-xxx-your-api-key - Claude Code 재시작 후 개발 시작

GLM-5와 MoAI-ADK의 조합은 비용 효율적이고 성능이 뛰어난 AI 개발 환경을 제공한다.